Premessa

Premessa

La profilazione delle persone fisiche è una delle questioni strutturalmente più rilevanti del diritto europeo in materia di protezione dei dati personali e, più recentemente, della disciplina sull'intelligenza artificiale. Il Regolamento (UE) 2016/679 (GDPR) le dedica una disciplina analitica, collocandola al crocevia tra la teoria generale delle basi giuridiche, il regime speciale delle decisioni automatizzate e il corpus dei diritti degli interessati. Il Regolamento (UE) 2024/1689 sull'intelligenza artificiale (AI Act) ne fa invece un criterio autonomamente sufficiente a determinare la classificazione di alto rischio di un sistema di IA. Tra i due strumenti il concetto di profilazione è formalmente il medesimo, fondandosi il secondo su rinvio recettizio al primo, ma le conseguenze giuridiche che ciascuno vi ricollega sono profondamente diverse.

Il presente contributo esamina la, la sua evoluzione interpretativa attraverso i lavori del Gruppo di Lavoro Articolo 29 e dell'EDPB, le ragioni per cui essa si distingue dalla segmentazione statistica, con particolare attenzione al contesto del marketing digitale, il regime di liceità e i diritti degli interessati, e infine il rapporto tra GDPR e AI Act con riguardo alla presunzione assoluta di alto rischio in presenza di funzionalità profilanti.

La definizione normativa di profilazione

L'articolo 4, paragrafo 4, del GDPR

Il GDPR fornisce una definizione espressa di profilazione all'articolo 4, paragrafo 4, ai sensi del quale per profilazione si intende «qualsiasi forma di trattamento automatizzato di dati personali consistente nell'utilizzo di tali dati personali per valutare determinati aspetti personali relativi a una persona fisica, in particolare per analizzare o prevedere aspetti riguardanti il rendimento professionale, la situazione economica, la salute, le preferenze personali, gli interessi, l'affidabilità, il comportamento, l'ubicazione o gli spostamenti di detta persona fisica».

Si tratta di una definizione ampia, che non è mutuata sic et simpliciter dalla legislazione previgente bensì inaugura un autonomo istituto nel diritto dell'Unione. Come osservano le Linee guida sul processo decisionale automatizzato relativo alle persone fisiche e sulla profilazione adottate dal Gruppo di Lavoro Articolo 29 il 6 febbraio 2018 (WP 251 rev. 01), il Regolamento si è ispirato alla definizione contenuta nella Raccomandazione del Consiglio d'Europa CM/Rec(2010)13 sulla protezione delle persone fisiche con riguardo al trattamento automatizzato di dati personali nel contesto di attività di profilazione, senza tuttavia riprodurla integralmente. La Raccomandazione del Consiglio d'Europa esclude dalla nozione di profilazione il trattamento che non comprenda la deduzione o inferenza, laddove il GDPR non incorpora esplicitamente tale requisito, adottando una formulazione potenzialmente più estesa.

I tre elementi costitutivi

Il WP 251 scompone analiticamente la definizione normativa nei suoi tre elementi costitutivi imprescindibili e cumulativi.

Il primo elemento è che il trattamento sia automatizzato. La norma usa l'espressione «qualsiasi forma di trattamento automatizzato», distinta dal trattamento «unicamente» automatizzato richiesto dall'articolo 22. Come chiarisce WP 251 rev. 01, la profilazione deve implicare una qualche forma di trattamento automatizzato, sebbene il coinvolgimento umano non comporti necessariamente l'esclusione dell'attività dalla definizione: l'automatismo è necessario, ma non deve essere esclusivo.

Il secondo elemento è che il trattamento sia effettuato su dati personali. Non è quindi possibile profilazione in senso giuridico su dati aggregati anonimi, poiché la tutela del Regolamento si rivolge esclusivamente alle persone fisiche identificate o identificabili.

Il terzo elemento, il più qualificante, è che il fine del trattamento sia la valutazione di aspetti personali relativi a una persona fisica determinata. Il WP 251 sottolinea che l'uso del verbo «valutare» implica che la profilazione non sia una mera raccolta di dati, ma comporti una forma di giudizio, previsione o valutazione concernente l'individuo. L'elenco esemplificativo del Regolamento (rendimento professionale, situazione economica, salute, preferenze, interessi, affidabilità, comportamento, ubicazione, spostamenti) è non tassativo e riflette la trasversalità dei domini su cui la profilazione può incidere.

Le tre fasi del processo di profilazione secondo il Consiglio d'Europa

Sebbene il GDPR non riprenda strutturalmente la Raccomandazione CM/Rec(2010)13, quest'ultima offre, come riconosce il WP 251, un utile schema descrittivo per comprendere le fasi processuali della profilazione. La Raccomandazione articola il fenomeno in tre momenti distinti e sequenziali:

- la raccolta dei dati, ossia l'acquisizione delle informazioni rilevanti sull'individuo o su gruppi di individui;

- l'analisi automatizzata di tali dati al fine di individuare correlazioni, pattern comportamentali o statistiche significative;

- l'applicazione delle correlazioni così individuate a un singolo individuo per identificare caratteristiche del suo comportamento presente o futuro.

Il titolare del trattamento che svolge attività di profilazione deve garantire il rispetto dei requisiti del GDPR in relazione a ciascuna di queste fasi, non soltanto in relazione alla fase applicativa finale.

Il percorso evolutivo della definizione: l'Advice Paper del 13 maggio 2013

Prima ancora dell'adozione del GDPR, il Gruppo di Lavoro Articolo 29 aveva elaborato in modo organico la propria posizione sulla necessità di introdurre una definizione di profilazione nel Regolamento in via di formazione, attraverso il Documento di consulenza sugli elementi essenziali di una definizione e una disposizione sulla profilazione nel contesto del Regolamento generale sulla protezione dei dati dell'UE, adottato il 13 maggio 2013. In quel documento il Gruppo di Lavoro aveva proposto una definizione secondo la quale per profilazione doveva intendersi «qualsiasi forma di trattamento automatizzato di dati personali, finalizzato ad analizzare o prevedere la personalità o certi aspetti personali relativi a una persona fisica», con esplicito riferimento alla salute, alla situazione economica, al rendimento professionale, alle preferenze personali o agli interessi, all'affidabilità o al comportamento, all'ubicazione o agli spostamenti.

Il Gruppo di Lavoro aveva altresì enfatizzato la necessità di una disciplina che non si limitasse alle sole conseguenze della profilazione (cioè alle decisioni che incidono sull'interessato), ma si estendesse già alla fase di creazione del profilo come tale: un'impostazione sistematica che il GDPR definitivo ha sostanzialmente recepito, affiancando alla norma speciale dell'articolo 22 la definizione generale dell'articolo 4, paragrafo 4. Nel medesimo documento, il Gruppo di Lavoro aveva sottolineato come la profilazione trovi applicazione in numerosi settori della vita quotidiana, profili di consumo, profili di movimento, profili di utente, profili sociali, e come il contesto dei Big Data amplifichi in misura esponenziale i rischi per il diritto fondamentale alla protezione dei dati.

Le tre modalità d'uso della profilazione secondo il WP 251

Il WP 251 individua, in via sistematica, tre possibili modalità d'uso della profilazione, che presentano conseguenze giuridiche profondamente diverse in termini di obblighi e garanzie applicabili.

La prima è la profilazione generale, ossia la mera costruzione di profili senza che a essi consegua una decisione automatizzata che incida significativamente sull'interessato. Questo tipo di trattamento è soggetto alle disposizioni generali del GDPR, i principi dell'articolo 5, la necessità di una base giuridica ai sensi dell'articolo 6, gli obblighi informativi degli articoli 13 e 14, il diritto di opposizione di cui all'articolo 21, ma non alle garanzie rafforzate dell'articolo 22.

La seconda è il processo decisionale basato sulla profilazione, nel quale una decisione concernente l'interessato viene adottata tenendo conto di un profilo prodotto con mezzi automatizzati, ma con l'intervento significativo di un essere umano nel processo decisionale finale. Si pensi al caso di un istituto bancario che valuta la concessione di un mutuo prendendo in considerazione il punteggio creditizio del richiedente, ma associando a esso un'analisi qualitativa svolta da un operatore umano prima dell'adozione della decisione definitiva.

La terza modalità, quella di massima rilevanza giuridica, è la decisione basata unicamente sul trattamento automatizzato, compresa la profilazione, che produce effetti giuridici o che incide in modo analogo significativamente sull'interessato ai sensi dell'articolo 22, paragrafo 1. In questa fattispecie, l'algoritmo decide autonomamente, senza alcun coinvolgimento umano sostanziale, e la decisione produce conseguenze rilevanti per i diritti e le libertà dell'individuo. Il WP 251 interpreta l'articolo 22 non come un diritto soggettivo da invocare attivamente, bensì come un divieto generale che si applica indipendentemente dal fatto che l'interessato intraprenda o meno un'azione in merito al trattamento dei propri dati personali.

La distinzione tra profilazione e segmentazione

Natura aggregata della segmentazione e criterio teleologico

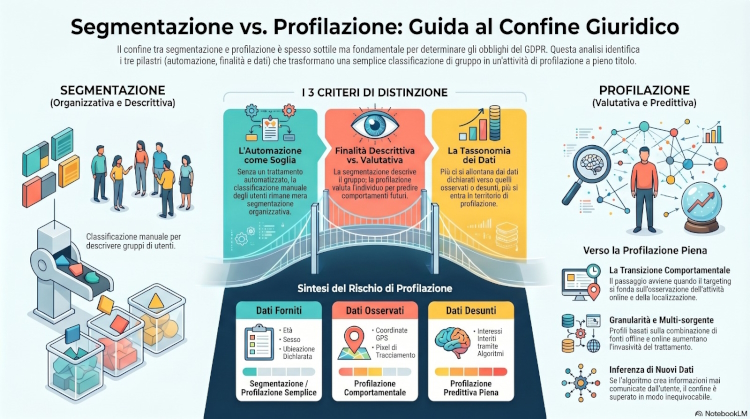

La distinzione tra profilazione e segmentazione è uno dei profili più delicati e praticamente rilevanti del diritto della protezione dei dati, perché investe operazioni che dal punto di vista tecnico possono presentarsi in modo assolutamente analogo, ma che producono conseguenze giuridiche radicalmente diverse. Nella prassi del marketing e dell'analisi statistica, la «segmentazione» indica la suddivisione di una base clienti o di una popolazione in gruppi omogenei basati su caratteristiche comuni, al fine di indirizzare più efficacemente prodotti o servizi. La segmentazione ha una logica fondamentalmente aggregata: produce conoscenza su gruppi, non necessariamente su individui, e il suo output primario è una classificazione di categorie, non un giudizio sulla singola persona.

Il WP 251 affronta il tema con una affermazione di grande chiarezza sistematica: «la semplice classificazione di persone basata su caratteristiche note quali età, sesso e altezza non determina necessariamente una profilazione. Quest'ultima dipende infatti dalla finalità della classificazione». Il documento aggiunge che un'azienda che classifica i propri clienti in base all'età o al sesso per finalità statistiche, al fine di acquisire una panoramica aggregata senza effettuare previsioni o trarre conclusioni in merito a una persona specifica, non svolge attività di profilazione: «la finalità non è la valutazione delle caratteristiche individuali e quindi non si tratta di profilazione». Il criterio discretivo è dunque di natura teleologica. La profilazione si distingue proprio per questo elemento di valutazione individualizzante: non si tratta di descrivere un gruppo, ma di inferire qualcosa sull'individuo a partire da dati propri o da correlazioni con i comportamenti statisticamente rilevati in altri individui simili.

Il contributo del Garante italiano: il provvedimento Intesa Sanpaolo/Isybank

La distinzione tra classificazione (segmentazione) e profilazione in senso giuridico ha trovato applicazione concreta nella prassi decisionale del Garante per la protezione dei dati personali, con particolare riguardo al provvedimento concernente il trasferimento della clientela da Intesa Sanpaolo a Isybank (provvedimento del 26 ottobre 2023, doc. web n. 10230412). In quella vicenda, la banca aveva sostenuto che l'attività di individuazione della cosiddetta «clientela prevalentemente digitale» non costituisse profilazione in senso giuridico bensì una mera classificazione della base clienti condotta «sulla base di criteri generali e oggettivi, oltre che senza l'ausilio di strumenti automatizzati». Il Garante ha riconosciuto che in assenza di trattamento automatizzato la mera attività di classificazione di interessati in categorie, anche se finalizzata a una migliore organizzazione dell'attività d'impresa, non può qualificarsi come profilazione in senso giuridico, confermando che il trattamento automatizzato è un requisito ineliminabile. Il Garante ha altresì precisato che la profilazione non deve necessariamente essere finalizzata allo svolgimento di attività di marketing per essere tale: l'elemento teleologico del marketing è irrilevante ai fini della qualificazione, che dipende dalla struttura del trattamento e non dalla sua destinazione commerciale.

Il ruolo dell'inferenza statistica

Un elemento ulteriore che contribuisce a distinguere la profilazione dalla mera segmentazione è la capacità della prima di generare dati derivati o desunti. Come sottolinea il WP 251, la profilazione «è una procedura che può implicare una serie di deduzioni statistiche» ed «è spesso impiegata per effettuare previsioni su persone usando dati provenienti da varie fonti per dedurre qualcosa su una persona in base alle qualità di altre persone che sembrano statisticamente simili». Un profilo non si limita a descrivere ciò che è già noto su una persona: esso produce nuova conoscenza per via deduttiva, attribuendo all'individuo caratteristiche che non ha direttamente comunicato. Questo meccanismo di inferenza è uno dei tratti più caratteristici e problematici della profilazione: non ci si limita a raggruppare l'individuo insieme ad altri in una categoria descrittiva, ma si ricavano informazioni nuove che lo stesso ignorava di aver «comunicato». La segmentazione statistica aggregata non produce questo effetto: i dati rimangono riferiti al gruppo, non all'individuo.

La capacità inferenziale della profilazione pone un ulteriore problema in relazione alle categorie particolari di dati di cui all'articolo 9 del GDPR. Il WP 251 chiarisce che la profilazione può creare dati appartenenti a categorie particolari desumendoli da dati che di per sé non appartengono a tali categorie ma che diventano tali se combinati con altri: ad esempio, è possibile desumere lo stato di salute di una persona associando le registrazioni dei suoi acquisti alimentari a dati sulla qualità e sul contenuto energetico degli alimenti acquistati. In tale ipotesi, il titolare del trattamento è tenuto a garantire non solo una condizione di liceità ai sensi dell'articolo 6, ma anche una delle condizioni di cui all'articolo 9, paragrafo 2.

La segmentazione ai fini di marketing: quando travalica nella profilazione

Il continuum tra segmentazione e profilazione nel contesto commerciale

La questione della segmentazione di marketing merita un'analisi autonoma e metodologicamente rigorosa, poiché è in questo contesto che la distinzione tra le due categorie si assottiglia in misura maggiore, e dove i rischi di una qualificazione erronea, con le conseguenti implicazioni in termini di base giuridica, obblighi informativi e diritti degli interessati, sono più concreti e frequenti.

Il primo criterio: l'automazione come soglia di accesso alla definizione. Il punto di partenza irrinunciabile è il requisito dell'automatizzazione del trattamento, che il WP 251 indica come elemento costitutivo primario della profilazione. L'esperienza applicativa, confermata dal Garante italiano nel provvedimento Intesa Sanpaolo/Isybank, dimostra che in assenza di trattamento automatizzato la mera classificazione degli interessati in categorie non può qualificarsi come profilazione in senso giuridico, «tanto più se finalizzata a una migliore organizzazione dell'attività d'impresa». Una campagna di email marketing indirizzata a tutti i clienti con contratti stipulati prima di una certa data, selezionati attraverso un'estrazione manuale dall'archivio, è, nella misura in cui non vi sia alcuna componente automatizzata di valutazione, una segmentazione priva di rilevanza ai sensi della normativa sulla profilazione.

Il secondo criterio: la finalità della classificazione come elemento teleologico discriminante. Anche quando l'automazione è presente, il WP 251 introduce un secondo fattore determinante: la finalità del trattamento. Il documento distingue tra due orientamenti fondamentalmente diversi dell'attività di classificazione: l'orientamento descrittivo-aggregato, che mira a rappresentare il gruppo senza giudicare o valutare l'individuo; e l'orientamento valutativo-individualizzante, che utilizza i dati del gruppo per inferire, predire o valutare caratteristiche dell'individuo. Solo il secondo integra profilazione.

Il terzo criterio: la tipologia dei dati impiegati secondo la tassonomia EDPB. Un contributo fondamentale alla sistemazione analitica del problema è offerto dalle Linee guida 8/2020 dell'EDPB sull'individuazione degli utenti dei social media, che elaborano una tassonomia tripartita:

- dati forniti, ossia le informazioni comunicate attivamente dall'interessato (età, sesso, stato di relazione, ubicazione dichiarata, preferenze esplicite);

- dati osservati, ossia i dati forniti dall'interessato in virtù dell'utilizzo di un servizio o di un dispositivo (attività sulla piattaforma, contenuti consultati, coordinate GPS, dati raccolti attraverso pixel su siti web di terzi, dati da carte fedeltà);

- dati desunti o derivati, ossia i dati creati dal titolare del trattamento sulla base dei dati forniti o osservati, attraverso algoritmi che inferiscono caratteristiche o propensioni dell'individuo a partire da correlazioni con il comportamento di altri soggetti simili. Questa tassonomia è direttamente funzionale all'individuazione del confine tra segmentazione e profilazione: quanto più ci si allontana dai dati forniti e ci si avvicina ai dati desunti, tanto più ci si trova in territorio di profilazione piena.

La zona grigia centrale: il targeting demografico automatizzato su dati forniti. L'esempio paradigmatico che il WP 251 fornisce per illustrare questa zona di confine è quello di una «pubblicità per un outlet di moda online basata su un semplice profilo demografico: "donne nella regione di Bruxelles di età compresa tra 25 e 35 che potrebbero essere interessate alla moda e ad alcuni capi di abbigliamento"». Il WP 251 definisce espressamente tale fattispecie come profilazione (parla di «semplice profilo demografico»), ma precisa immediatamente che tale forma di profilazione «in numerosi casi tipici non inciderà in modo analogo significativamente sulle persone» ai sensi dell'articolo 22. In altri termini, anche il targeting demografico automatizzato può integrare profilazione ai sensi dell'articolo 4, paragrafo 4, senza tuttavia produrre effetti tali da attivare il divieto dell'articolo 22.

Le Linee guida 8/2020 dell'EDPB analizzano un caso analogo (Esempio 1: impresa X che vuole rivolgersi a uomini tra i 30 e i 45 anni che hanno indicato di essere single nel loro profilo sui social media, con targeting attivo tra le ore 17:00 e le 20:00) qualificandolo come targeting basato su dati forniti e sottoponendolo all'intero apparato di obblighi del GDPR, base giuridica, trasparenza, contitolarità, senza tuttavia trattarlo come profilazione predittiva o comportamentale. La differenza rispetto a quest'ultima è che il targeting su dati forniti si limita a selezionare gli individui che appartengono a un segmento demograficamente definito sulla base di caratteristiche che essi stessi hanno comunicato, senza inferire nuove informazioni né costruire un profilo comportamentale.

La transizione verso la profilazione piena: dati osservati, combinazione di fonti e inferenza. La transizione da segmentazione a profilazione in senso pieno si compie al ricorrere di elementi concorrenti. In primo luogo, il passaggio da dati forniti a dati osservati: non appena il targeting commerciale si fonda sull'attività comportamentale dell'utente (pagine visitate, contenuti consultati, comportamento d'acquisto, localizzazione GPS, interazioni con pixel di tracciamento), si entra nel dominio della profilazione comportamentale, che il WP 171 (Parere 2/2010 sulla pubblicità comportamentale) aveva già distinto nella categoria dei profili predittivi, «stabiliti per deduzione attraverso l'osservazione del comportamento individuale e collettivo dell'utente nel corso del tempo». In secondo luogo, la combinazione di fonti eterogenee: le Linee guida 8/2020 evidenziano che i fornitori di social media raccolgono dati «combinando dati provenienti da più fonti, online e offline» al fine di generare «ulteriori approfondimenti», e che questa aggregazione multi-sorgente costituisce il motore della profilazione avanzata. In terzo luogo, l'impiego di dati desunti: quando un fornitore o un targeter «deduce che una persona fisica è probabilmente interessata a una determinata attività o a un certo prodotto sulla base del suo comportamento di navigazione in internet e/o dei suoi collegamenti di rete», il confine è superato in modo inequivoco, poiché si generano dati nuovi sull'individuo che non corrispondono a nulla che l'interessato abbia comunicato, ma che sono il prodotto di un'inferenza algoritmica.

Il quarto elemento: la granularità come fattore di intensificazione. Il WP 251 introduce un ulteriore fattore qualitativo rilevante tanto ai fini della qualificazione quanto della valutazione dell'invasività del trattamento: il livello di dettaglio del profilo. Il documento distingue esplicitamente tra un interessato «profilato in un gruppo descritto in maniera ampia come "persone interessate alla letteratura inglese"» e un interessato «segmentato e mirato a livello granulare». Quanto più il profilo è granulare, completo e basato su una molteplicità di fonti e di inferenze, tanto più difficile sarà giustificare il trattamento mediante legittimo interesse e tanto più intensa sarà l'aspettativa dell'EDPB che sia richiesto il consenso esplicito.

La pubblicità comportamentale come forma paradigmatica di profilazione di marketing

Il caso limite, e oggi il più diffuso nella pratica commerciale digitale, è quello della pubblicità comportamentale online, analizzato in profondità dal Gruppo di Lavoro nel Parere 2/2010 sulla pubblicità comportamentale online (WP 171). In quel documento il Gruppo di Lavoro aveva distinto due principali metodologie: i profili predittivi, stabiliti per deduzione attraverso l'osservazione del comportamento individuale e collettivo dell'utente nel corso del tempo (monitoraggio delle pagine visitate, dei messaggi pubblicitari visualizzati o cliccati); e i profili espliciti, creati a partire da dati personali che l'interessato stesso ha fornito a un servizio web all'atto della registrazione. Entrambe le metodologie configurano profilazione in senso pieno ai sensi dell'attuale articolo 4, paragrafo 4, del GDPR.

L'elemento che distingue strutturalmente la pubblicità comportamentale dalla segmentazione demografica classica è precisamente la dimensione predittiva e inferenziale che la prima implica: non si tratta di collocare l'individuo in un gruppo sulla base di caratteristiche osservate e dichiarate, ma di prevedere il suo comportamento futuro, la propensione all'acquisto, la probabilità di risposta a una certa offerta, il profilo di interessi, a partire da tracce digitali lasciate nel tempo. Questo processo integra in modo paradigmatico la definizione dell'articolo 4, paragrafo 4, che fa esplicito riferimento alla finalità di «analizzare o prevedere» aspetti riguardanti l'interessato.

Il caso del micro-targeting

L'evoluzione tecnica ha prodotto un ulteriore punto di addensamento critico: il cosiddetto micro-targeting, pratica descritta nelle Linee guida 8/2020 dell'EDPB sull'individuazione degli utenti dei social media, consistente nella selezione tanto del messaggio quanto della platea di destinatari in base alle caratteristiche, agli interessi o alle preferenze percepite delle persone fisiche in questione. Il micro-targeting combina profilazione granulare e segmentazione di marketing in un'unica operazione: attinge a profili costruiti mediante trattamento automatizzato di dati comportamentali per inviare comunicazioni commerciali o politiche calibrate sul singolo individuo o su segmenti definiti con precisione millimetrica. In questo contesto, la distinzione tra segmentazione e profilazione svanisce del tutto: l'attività è necessariamente profilazione ai sensi del GDPR.

Uno schema di qualificazione progressiva

Muovendo dalle fonti esaminate, è possibile proporre uno schema di qualificazione progressiva articolato su tre livelli. Al primo livello si collocano le attività che rimangono nell'ambito della segmentazione pura: classificazione manuale senza automazione, o classificazione automatizzata ma finalizzata esclusivamente all'acquisizione di una panoramica aggregata del cliente senza produrre valutazioni, previsioni o inferenze riferite al singolo individuo. Al secondo livello si collocano le attività di profilazione demografica di base: targeting automatizzato su dati forniti dall'interessato (età, sesso, ubicazione dichiarata, preferenze esplicitamente comunicate), con finalità di comunicazione commerciale ma senza inferenza di dati nuovi né previsione del comportamento individuale. Questo livello integra già la definizione dell'articolo 4, paragrafo 4, e richiede una base giuridica e trasparenza adeguate, ma non produce tipicamente effetti significativi ai sensi dell'articolo 22. Al terzo livello si collocano le attività di profilazione comportamentale e predittiva: targeting fondato su dati osservati (comportamento di navigazione, acquisti, localizzazione, interazioni), dati desunti (interesse probabilistico dedotto algoritmicamente), combinazione di fonti eterogenee, tracciamento cross-dispositivo o cross-servizio. Questo livello integra pienamente la definizione dell'articolo 4, paragrafo 4, richiede una base giuridica robusta (tipicamente il consenso), è difficilmente fondabile sul legittimo interesse e produce rischi elevati che potrebbero rendere necessaria la conduzione di una DPIA.

Il regime di liceità della profilazione

Le basi giuridiche applicabili

La profilazione non è vietata in via generale dal GDPR, ma è soggetta alle medesime condizioni di liceità che disciplinano qualsiasi trattamento di dati personali. Come afferma il considerando 72 del Regolamento, «la profilazione è soggetta alle norme del presente regolamento che disciplinano il trattamento dei dati personali, quali le basi giuridiche del trattamento (articolo 6) o i principi di protezione dei dati (articolo 5)».

Il consenso dell'interessato ai sensi dell'articolo 6, paragrafo 1, lettera a), è la base giuridica più frequentemente invocata nel contesto della profilazione di marketing, e in molti casi costituisce l'unica base giuridica praticabile, in particolare per la profilazione comportamentale online che comporta l'uso di cookie e tecnologie di tracciamento. Il Gruppo di Lavoro, nel WP 171, aveva già stabilito che i titolari del trattamento devono ottenere il consenso preventivo degli interessati per installare i cookie necessari a svolgere attività di pubblicità comportamentale.

La necessità contrattuale ai sensi dell'articolo 6, paragrafo 1, lettera b), non può essere invocata come base giuridica per creare un profilo dei gusti e delle scelte di stile di vita dell'utente sulla base della sequenza di clic effettuati su un sito web o degli articoli acquistati, poiché il titolare del trattamento non ha stipulato un contratto per elaborare profili, bensì per fornire beni o servizi specifici. Come osserva l'EDPB nelle Linee guida sull'interpretazione dell'articolo 6, paragrafo 1, lettera b), sarebbe difficile sostenere che un contratto non sia stato eseguito in assenza di annunci di pubblicità comportamentale.

Il legittimo interesse ai sensi dell'articolo 6, paragrafo 1, lettera f), è astrattamente applicabile anche alla profilazione, come riconosce il WP 251, ma il WP 217 (Parere 06/2014 sul concetto di interesse legittimo), richiamato espressamente dal WP 251, suggerisce che «sarebbe difficile per il titolare del trattamento giustificare il ricorso al legittimo interesse come base legittima per pratiche intrusive di profilazione e tracciamento per finalità di marketing o pubblicità, ad esempio quelle che comportano il tracciamento di persone fisiche su più siti web, ubicazioni, dispositivi, servizi o l'intermediazione di dati».

Il legittimo interesse e l'obbligo di LIA

Affinché il trattamento possa basarsi sull'articolo 6, paragrafo 1, lettera f), devono essere contemporaneamente soddisfatte le tre condizioni cumulative enunciate dalla Corte di Giustizia dell'Unione Europea al paragrafo 106 della sentenza del 4 luglio 2023, causa C-252/21 (Meta Platforms Inc. e altri c. Bundeskartellamt): il perseguimento di un legittimo interesse del titolare del trattamento o di terzi, la necessità del trattamento dei dati personali per la realizzazione del legittimo interesse perseguito, e la condizione che gli interessi o i diritti e le libertà fondamentali dell'interessato non prevalgano sul legittimo interesse perseguito.

Come ha chiarito il Garante italiano nel provvedimento Intesa Sanpaolo/Isybank, tale approccio è stato confermato dalle Linee guida 1/2024 dell'EDPB sull'applicazione dell'articolo 6, paragrafo 1, lettera f), GDPR: il legittimo interesse non può essere invocato in maniera automatica o strumentale, ma solo a seguito dell'adozione di misure opportune e di una documentazione rigorosa che giustifichi la scelta di avvalersi di tale base giuridica. Il titolare che si avvale del legittimo interesse deve pertanto procedere a una ponderazione che tenga conto, in modo specifico, del livello di dettaglio del profilo, della completezza del quadro che lo stesso disegna sull'individuo, dell'impatto concreto della profilazione sui diritti e le libertà degli interessati, e delle garanzie adottate per assicurare la correttezza, la non discriminazione e l'esattezza del processo.

I diritti degli interessati in relazione alla profilazione

Trasparenza e diritto di essere informato

La trasparenza costituisce il pilastro fondamentale della disciplina della profilazione. Il WP 251 osserva che spesso il processo di profilazione è invisibile all'interessato: opera creando dati derivati o desunti che non sono stati forniti direttamente dall'individuo, e che alcune persone potrebbero avere difficoltà a comprendere a causa della complessità delle tecniche coinvolte. Il Regolamento impone che il titolare del trattamento fornisca agli interessati informazioni concise, trasparenti, intelligibili e facilmente accessibili. Le Linee guida sulla trasparenza (WP 260 rev. 01) specificano che le informazioni sull'esistenza di un processo decisionale automatizzato comprendente la profilazione, nella misura in cui si applica l'articolo 22, devono includere indicazioni significative sulla logica utilizzata, nonché sull'importanza e sulle conseguenze previste per l'interessato. Le stesse linee guida sottolineano che il principio secondo cui il trattamento non dovrebbe cogliere di sorpresa l'interessato si applica alla profilazione in generale, non solo a quella descritta all'articolo 22.

Il diritto di opposizione ex articolo 21

L'articolo 21 del GDPR riconosce all'interessato un diritto di opposizione alla profilazione articolato in due regimi distinti. Il primo, di carattere generale, si applica alla profilazione fondata sull'articolo 6, paragrafo 1, lettere e) o f): l'interessato può opporsi per motivi connessi alla sua situazione particolare, e il titolare del trattamento può resistere all'opposizione solo dimostrando l'esistenza di motivi legittimi cogenti che prevalgono sugli interessi, sui diritti e sulle libertà dell'interessato. Il WP 251 precisa che in questo bilanciamento il titolare non può limitarsi a riproporre la medesima valutazione che aveva condotto a scegliere il legittimo interesse come base giuridica: deve dimostrare che l'interesse legittimo è cogente, il che implica una soglia più elevata rispetto a quella del bilanciamento iniziale.

Il secondo regime, di carattere assoluto, riguarda la profilazione connessa al marketing diretto: ai sensi dell'articolo 21, paragrafo 2, l'interessato ha il diritto incondizionato di opporsi al trattamento dei propri dati personali per finalità di marketing diretto, compresa la profilazione nella misura in cui sia connessa a tale marketing diretto. Come chiarisce il WP 251, il titolare del trattamento deve rispettare le volontà dell'interessato senza mettere in discussione i motivi dell'opposizione, e il considerando 70 specifica che il diritto può essere esercitato in qualsiasi momento e gratuitamente.

Il divieto generale dell'articolo 22 e la sua distinzione dall'articolo 21

L'articolo 22, paragrafo 1, stabilisce che l'interessato ha il diritto di non essere sottoposto a una decisione basata unicamente sul trattamento automatizzato, compresa la profilazione, che produca effetti giuridici che lo riguardano o che incida in modo analogo significativamente sulla sua persona. Il WP 251 interpreta questa disposizione come un divieto generale, operante come tale a prescindere da qualsiasi iniziativa dell'interessato, che conosce tre sole eccezioni tassativamente previste dal paragrafo 2 (esecuzione di un contratto, autorizzazione legale, consenso esplicito), con obblighi rafforzati di trasparenza e garanzie specifiche.

Gli effetti «giuridici» o «in modo analogo significativi» non sono definiti dal Regolamento, ma il WP 251 ne fornisce un'interpretazione sistematica: un effetto giuridico richiede che la decisione incida sui diritti giuridici dell'individuo (cancellazione di un contratto, concessione o negazione di prestazioni sociali, rifiuto dell'ammissione in un paese); un effetto significativo analogo comprende, tra l'altro, decisioni che si traducono in una fissazione dei prezzi differenziata basata su dati personali tale da impedire effettivamente l'accesso a determinati beni o servizi, oppure la riduzione del limite di una carta di credito sulla base non dello storico del singolo cliente ma di criteri basati su altri clienti che vivono nella medesima area e acquistano presso i medesimi negozi.

L'articolo 22 e l'articolo 21 sono dunque regimi distinti e non sovrapponibili: il primo si applica alle decisioni pienamente automatizzate con effetti significativi e opera come divieto con eccezioni tipizzate; il secondo si applica a qualsiasi forma di profilazione (non necessariamente tradotta in decisioni automatizzate) e conferisce un diritto di opposizione all'interessato.

Le garanzie strutturali: principi, DPIA e data protection by design

Il rispetto dei principi di cui all'articolo 5 del GDPR si impone con forza particolare nel contesto della profilazione. La minimizzazione dei dati e la limitazione della conservazione operano come freno alle derive accumulative tipiche delle architetture di profilazione intensiva. La limitazione della finalità, oggetto specifico del Parere 03/2013 del Gruppo di Lavoro (WP 203), assume rilievo ogni qual volta si intenda impiegare dati raccolti per una finalità originaria per costruire profili finalizzati a usi commerciali ulteriori: in tali casi deve essere verificata la compatibilità della finalità secondaria con quella originaria ai sensi dell'articolo 6, paragrafo 4.

L'articolo 35, paragrafo 3, lettera a), impone la conduzione di una Valutazione d'Impatto sulla Protezione dei Dati (DPIA) nel caso di «valutazione sistematica e globale di aspetti personali relativi a persone fisiche, basata su un trattamento automatizzato, compresa la profilazione, e sulla quale si fondano decisioni che hanno effetti giuridici o incidono in modo analogo significativamente su dette persone fisiche». Il WP 251 precisa che la DPIA è obbligatoria anche quando il trattamento basato su profilazione non sia unicamente automatizzato, purché da esso derivino decisioni significative: l'ambito di applicazione dell'articolo 35, paragrafo 3, lettera a), è quindi più ampio di quello dell'articolo 22, paragrafo 1.

La protezione dei dati fin dalla progettazione e per impostazione predefinita ai sensi dell'articolo 25 costituisce un requisito fondamentale anche per i sistemi di profilazione: il titolare del trattamento deve garantire che già in sede di progettazione dell'algoritmo e dell'architettura tecnica vengano incorporate misure idonee ad attuare i principi di protezione dei dati.

Il WP 251 raccomanda infine che il titolare effettui valutazioni frequenti degli insiemi di dati trattati al fine di rilevare eventuali distorsioni (bias) algoritmiche, sviluppando metodi per affrontare elementi pregiudizievoli, compreso un eccessivo affidamento sulle correlazioni statistiche che potrebbe condurre a classificazioni errate o a valutazioni discriminatorie.

La profilazione nell'AI Act: rinvio definitorio e complementarietà con il GDPR

Il rinvio recettizio al GDPR

Il Regolamento (UE) 2024/1689 non introduce una definizione autonoma di profilazione, ma richiama espressamente quella del GDPR. L'articolo 3 dell'AI Act contiene un apposito punto dedicato alla «profilazione», definita mediante rinvio alla nozione di cui all'articolo 4, punto 4, del Regolamento (UE) 2016/679. Si tratta di un rinvio recettizio che comporta un'importante conseguenza sistematica: i due regolamenti condividono formalmente lo stesso concetto di profilazione, e le elaborazioni interpretative prodotte dall'EDPB e dalle autorità di controllo nell'ambito del GDPR, compreso il WP 251 rev. 01, rimangono rilevanti anche per l'applicazione dell'AI Act.

La complementarietà tra AI Act e GDPR

Il considerando 10 dell'AI Act chiarisce espressamente che il regolamento «non mira a pregiudicare l'applicazione del vigente diritto dell'Unione che disciplina il trattamento dei dati personali», precisando che «gli interessati continuano a godere di tutti i diritti e le garanzie loro conferiti da tale diritto dell'Unione, compresi i diritti connessi al processo decisionale esclusivamente automatizzato relativo alle persone fisiche, compresa la profilazione». I due strumenti normativi non sono in rapporto di specialità o di deroga, ma di complementarietà funzionale: il GDPR regola il trattamento dei dati personali; l'AI Act regola i sistemi che realizzano tale trattamento quando assumono la forma di tecnologie di intelligenza artificiale. Le organizzazioni che sviluppano o utilizzano sistemi di IA che effettuano profilazione devono soddisfare cumulativamente i requisiti di entrambi i regolamenti.

L'assenza di differenze sostanziali nella definizione e la diversità delle conseguenze

Non esistono differenze sostanziali tra il concetto di profilazione nel GDPR e quello nell'AI Act: la nozione è identica per definizione, essendo il secondo fondato su rinvio al primo. Ciò che cambia radicalmente non è il concetto, ma la conseguenza giuridica che ne deriva. Nel GDPR la profilazione è un trattamento che richiede base giuridica, trasparenza e rispetto dei diritti degli interessati, ma non comporta di per sé presunzioni assolute di illiceità né procedure straordinarie (salvo il caso dell'articolo 22). Nell'AI Act, invece, la profilazione assume il ruolo di classificatore di rischio assoluto per i sistemi che operano nei domini elencati nell'Allegato III.

La profilazione come criterio determinante per la classificazione di alto rischio nell'AI Act

Il meccanismo di classificazione dell'articolo 6

L'articolo 6 dell'AI Act stabilisce le regole per la classificazione dei sistemi di IA ad alto rischio. Il paragrafo 2 prevede che siano considerati ad alto rischio i sistemi elencati nell'Allegato III, raggruppati in otto domini: biometria; infrastrutture critiche; istruzione e formazione professionale; occupazione e gestione dei lavoratori; accesso a servizi essenziali privati e pubblici; attività di contrasto; immigrazione e gestione delle frontiere; amministrazione della giustizia e processi democratici.

Il paragrafo 3 introduce una clausola di attenuazione: un sistema dell'Allegato III «non è considerato ad alto rischio se non presenta un rischio significativo di danno per la salute, la sicurezza o i diritti fondamentali delle persone fisiche, anche nel senso di non influenzare materialmente il risultato del processo decisionale». Questa clausola si applica quando il sistema è destinato a eseguire un compito procedurale limitato, a migliorare un'attività umana già completata, a rilevare schemi decisionali senza sostituire la valutazione umana, o a eseguire compiti preparatori per una valutazione. Il fornitore che intende avvalersi di questa clausola è tenuto a documentare la propria valutazione e a rispettare l'obbligo di registrazione di cui all'articolo 49, paragrafo 2.

La presunzione assoluta in caso di profilazione

È proprio in questo contesto che si inserisce la disposizione più rilevante ai fini del presente contributo. Il secondo comma dell'articolo 6, paragrafo 3, stabilisce che «un sistema di IA di cui all'allegato III è sempre considerato ad alto rischio qualora esso effettui profilazione di persone fisiche». La locuzione «fatto salvo il primo comma» è decisiva: essa sancisce che la clausola di attenuazione non opera quando il sistema effettua profilazione. La profilazione è un'eccezione all'eccezione: anche il sistema che in astratto potrebbe non considerarsi ad alto rischio ricade obbligatoriamente in quella categoria se svolge attività di profilazione nell'ambito dei domini dell'Allegato III. Il meccanismo è quello di una presunzione che non ammette prova contraria da parte del fornitore.

Le ragioni della presunzione

Le ragioni di questa scelta legislativa si fondano su considerazioni convergenti, ricavabili dal testo del regolamento e dalla sua struttura valoriale.

La prima ragione è la natura intrinsecamente individuale e inferenziale del processo profilante. La profilazione produce nuova conoscenza sulla persona attraverso deduzioni statistiche che prescindono dalla sua consapevolezza e volontà. Anche quando è effettuata su dati non sensibili in senso stretto, può rivelare informazioni appartenenti alle categorie particolari di cui all'articolo 9 del GDPR per effetto delle correlazioni inferite. Questa capacità penetrativa è la ragione per cui il legislatore ha ritenuto che nessuna valutazione contestuale possa escludere il rischio quando la profilazione opera in settori ad alto impatto sulla vita delle persone.

La seconda ragione riguarda il rischio di discriminazione algoritmica. I sistemi di IA che profilano le persone operano ricavando pattern da dati storici. Se questi dati rispecchiano disuguaglianze strutturali preesistenti, il sistema tenderà a riprodurle e potenzialmente ad amplificarle, con effetti sistematicamente sfavorevoli per determinati gruppi. Questo rischio è tanto più grave quanto più significativo è il dominio in cui opera il sistema, e tutti i domini dell'Allegato III sono per definizione domini ad alto impatto sulle posizioni individuali.

La terza ragione è di ordine valoriale ed è esplicitata nel considerando 42 del Regolamento, dove si afferma che le persone fisiche «non dovrebbero mai essere giudicate sulla base di un comportamento previsto dall'IA basato unicamente sulla profilazione, sui tratti della personalità o su caratteristiche quali la cittadinanza, il luogo di nascita, il luogo di residenza, il numero di figli, il livello di indebitamento o il tipo di automobile, senza che vi sia un ragionevole sospetto che la persona sia coinvolta in un'attività criminosa sulla base di fatti oggettivi verificabili e senza una valutazione umana al riguardo». Questo principio, formulato con specifico riferimento al contesto penale, esprime una posizione di carattere più generale: la dignità e l'autonomia della persona esigono che le decisioni che la riguardano siano fondate sul suo comportamento effettivo, non su previsioni ricavate da un profilo statistico.

La quarta ragione è l'opacità strutturale dei sistemi che effettuano profilazione mediante IA. I modelli di machine learning su cui si basa la profilazione contemporanea non rendono trasparente la logica che conduce dall'insieme dei dati in input al profilo generato in output. Questa opacità rende difficile per l'interessato comprendere, contestare e correggere le valutazioni che lo riguardano. Il regime di alto rischio, che impone tra l'altro obblighi di trasparenza (articolo 13 AI Act), supervisione umana (articolo 14) e documentazione tecnica (articoli 11 e 12), è il meccanismo attraverso cui il legislatore risponde a questa opacità.

La quinta ragione è di prevenzione del rischio cumulativo. Nei settori dell'Allegato III, la profilazione non opera mai in isolamento: si inserisce in catene decisionali che possono determinare l'accesso o la negazione di prestazioni sociali, opportunità lavorative, condizioni creditizie, garanzie processuali. Anche un errore sistematico di modesta entità può produrre effetti a cascata su categorie intere di persone, in modo difficilmente reversibile.

Gli obblighi derivanti dalla classificazione di alto rischio

La presunzione assoluta di alto rischio attiva un regime di conformità articolato. Il fornitore è tenuto a implementare un sistema di gestione dei rischi (articolo 9), a garantire qualità e rappresentatività dei dati di addestramento (articolo 10), a produrre e aggiornare documentazione tecnica (articolo 11), a implementare la registrazione automatica degli eventi (articolo 12), ad assicurare trasparenza adeguata agli utilizzatori (articolo 13), a predisporre meccanismi di supervisione umana (articolo 14) e a garantire accuratezza, robustezza e cibersicurezza (articolo 15). I deployer che operano in determinati settori sono tenuti a condurre una valutazione d'impatto sui diritti fondamentali prima della messa in servizio (articolo 27).

È importante chiarire che la qualificazione come alto rischio ai sensi dell'AI Act non esime il titolare del trattamento dagli obblighi derivanti dal GDPR: i due regimi si sovrappongono cumulativamente. Un sistema di IA che effettua profilazione deve soddisfare contemporaneamente i requisiti tecnici e procedurali dell'AI Act e gli obblighi in materia di liceità del trattamento, trasparenza, esercizio dei diritti e, ove dovuta, DPIA ex articolo 35 del GDPR.

Osservazioni conclusive

La profilazione è un istituto giuridico autonomo, definito dall'articolo 4, paragrafo 4, del GDPR con riferimento a tre elementi costitutivi cumulativi: l'automazione del trattamento, l'impiego di dati personali e la finalità valutativa riferita all'individuo. Non è un fenomeno monolitico, ma si articola in un continuum che va dalla profilazione generale alle decisioni pienamente automatizzate con effetti significativi soggette al regime speciale dell'articolo 22.

La segmentazione intesa come classificazione aggregata di gruppi omogenei, condotta senza trattamento automatizzato o senza finalità valutativa riferita al singolo individuo, non integra la definizione di profilazione ai sensi del Regolamento: il discrimine è teleologico e strutturale. La segmentazione di marketing occupa tuttavia una posizione intermedia e tendenzialmente instabile: nella sua forma elementare rimane al di fuori della profilazione; nella sua forma avanzata, soprattutto quando si avvale di trattamento automatizzato, tracciamento comportamentale, inferenza predittiva e combinazione di fonti eterogenee, si trasforma in profilazione piena, soggetta all'intero apparato garantistico del GDPR.

La definizione di profilazione è formalmente identica nel GDPR e nell'AI Act, essendo il secondo fondato su rinvio esplicito alla prima. Le differenze tra i due strumenti non riguardano il concetto, ma la conseguenza giuridica: nel GDPR la profilazione è un trattamento soggetto a disciplina ordinaria, con la fattispecie aggravata dell'articolo 22; nell'AI Act essa è anche un classificatore di rischio assoluto, operante come presunzione non superabile di alto rischio per qualunque sistema che la realizzi nell'ambito dei domini dell'Allegato III.

Per le organizzazioni che sviluppano o utilizzano sistemi di IA nei domini dell'Allegato III, la presenza di funzionalità profilanti non è un fattore che può essere gestito in modo isolato: richiede una strategia integrata che assicuri conformità simultanea al GDPR e all'AI Act, con documentazione tecnica e organizzativa adeguata a entrambi gli impianti normativi. Il confine tra lecita attività di analisi e profilazione priva di adeguata base giuridica non è una questione di etichetta nominale, ma di struttura del trattamento, di finalità perseguita, di grado di automatizzazione e di impatto sull'individuo: una valutazione caso per caso, rigorosa e documentata, rimane il solo strumento disponibile per navigare questo spazio con consapevolezza giuridica adeguata.

Dott. Roberto Pagano

Privacy Officer e Consulente della Privacy

Fondatore di WRP Srl, IusPrivacy.eu e co-founder cercolavoro.com, Data Protection Officer certificato esperto in legal tech in materia di protezione dei dati e IA